Loab, Screenshot aufgenommen am 4. September 2023

Körpermaschinen

Maya Indira Ganesh

Digitale Technologien haben unsere intimen Beziehungen aus dem Gleichgewicht gebracht und umgestaltet: Das Versprechen von Nähe und sofortiger Verbindung weicht einer Erfahrung von Distanz und Verzögerung. Welche Auswirkungen wird die Einführung von KI in alle Aspekte unseres persönlichen Lebens für das Genderverhältnis, unsere Körperbilder und die Zukunft der Intimität haben? In diesem Essay werden einige der komplexen Verschmelzungen von Verkörperung, Sprache, Kultur, Biologie, Politik und Poesie hervorgehoben, die zeigen, auf welche Weise sich die Distanz zwischen Mensch und Maschine vergrößert und verringert.

Wir machen uns Gedanken darüber, wie wir mit der Ausbreitung von KI leben, wie wir sie steuern und regulieren können. Es handelt sich dabei um Technologien der Logik, des Denkens, der Mathematik und der Sprache, also um die am höchsten geschätzten und verehrten menschlichen Fähigkeiten, die unserer Meinung nach oberhalb des Halses stattfinden. In diesem Essay geht es darum, was unterhalb der Schultern passiert – und wie sich unsere Beziehung zu diesem Körperbereich mit dem Aufkommen von KI in Form von Large Language Models (LLMs) und Technologien zur Bildgenerierung verändert (oder auch nicht). Unser Verständnis vom Verhältnis zwischen Geist und Körper war schon immer rätselhaft; es wird wahrscheinlich noch rätselhafter, wenn neue Konfigurationen von Gender, Geschlecht und Verkörperung durch unsere Beziehungen zu körperlosen, nicht-menschlichen digitalen Akteur*innen entstehen, die über hochentwickelte Sprachfähigkeiten verfügen, welche wiederum auf großen Mengen menschlicher Sprachdaten basieren.

Ende Dezember 2022 experimentierte ich mit Lensa herum, einem Bildbearbeitungsprogramm, das mit Hilfe des KI-Bildgenerators Stable Diffusion digitale Avatare auf der Grundlage von Selfies erstellt. Avatare werden häufig für Profilbilder in sozialen Medien, Videochats und in Spielen benutzt. Im Gegensatz zu Bildbearbeitungsprogrammen, die bestimmte Stile auf ein bestehendes Foto übertragen, verwendet Lensa die Software Stable Diffusion und CLIP, einen Datensatz mit 400 Millionen Bildern, um ein Selfie zu analysieren und neue Iterationen auf der Grundlage von voreingestellten künstlerischen Stilen zu erzeugen. Die Ergebnisse, die in Reaktion auf meine Selfies entstanden, waren teils fantastisch, teils verspielt, teils gebrochen – jedes „im Stil von“ irgendetwas und großzügig sexualisiert. [1] Keines dieser Bilder zeigt „mich“. Es sind bloß Bilder, die auf Basis anderer Bilder entstanden. Psycholog*innen haben jedoch herausgefunden, dass digitale Avatare und Online-Identitäten es den Menschen ermöglichen, ein idealisiertes Selbst zu erschaffen und zu präsentieren, das auf unumgängliche Weise von ihrem realen Selbst getrennt ist. Manche Menschen nutzen diese Trennung, um Verhaltensweisen an den Tag zu legen, die sie offline oder in ihrer „realen“ Identität nicht an den Tag legen würden; andere setzen dieses idealisierte Selbst ein, um online mit anderen in Kontakt zu treten. [2] Wie bei allen Spielen und im Theater ist die Beziehung zwischen dem realen, verkörperten Selbst und dem gespielten Selbst spannungsgeladen, fesselnd und ein bisschen feucht-klebrig. Diese Dialektik von Anwesenheit/Abwesenheit ist selbst in ihrer verwirrenden Instabilität seltsam befriedigend; wie ein loser Zahn, an dem man gerne mit der Zunge herumspielt. Wie weit kann man ihn drücken, ohne dass er rausbricht? Genauso fühlt sich das Menschsein in Zeiten der KI an. Wie eine scheinbar endlose Schleife aus Mensch-Maschine-Mensch-Maschine – bis man nicht mehr sicher sein kann, wo das eine beginnt und das andere aufhört. Bis die Schleife zerreisst.

Welche Bedeutung hat der Körper in Zeiten von KI? Generative KI, die nicht in der Lage ist, Bilder von menschlichen Händen zu erstellen, weil Hände und Arme in den Trainingsdatensätzen zu selten vorkommen. Mark Zuckerbergs Metaversum, in dem digitale Avatare keine Beine haben. [3] Die durch ChatGPT forcierte Bestätigung, dass etwas, das dem Menschen ähnelt, zu Sprache und Vernunft fähig sein muss: zum Verfassen von Gedichten, Lösen mathematischer Probleme oder Bestehen eines Juraexamens. Wozu brauchen wir noch Körper, wenn sie erst einmal die Daten erzeugt haben, um große Bild- und Sprachmodelle zu speisen, die Gesichter, Posen und diverse Möglichkeiten in Bezug auf Gender und Sexualität endlos replizieren? [4] Wir sind stochastische Papageien; wir sind Vogelfutter. [5] In einer KI-Welt kann der Körper (ungeachtet der Probleme mit Händen, Ohren und Zähnen) immer genauer definiert werden – und doch ganz verschwinden. Online-Avatare und KI-generierte Hologramme, wie sie in Bladerunner 2049 präsentiert werden, können nicht mehr weit weg sein. In der allgegenwärtigen Online-Welt reagieren wir auf virtuelle Bilder und Formen, die aus den Daten echter Menschen generiert werden. Doch das Begehren findet auf individueller Ebene statt, nicht in einer dyadischen oder dialogischen Weise. Vor kurzem erstellte der Organisator einer Tech-Konferenz gefälschte Profile von weiblichen Rednerinnen, um den Anschein zu erwecken, die Veranstaltung sei „divers“, obwohl das in Wirklichkeit nicht der Fall war. [6] Es gibt aber auch Menschen, die Maschinen spielen. Die Social-Media-Persönlichkeit Pinkydoll sendet per Livestream ihre verkörperten, sprachlichen Reaktionen auf GIFs, Memes und Emojis, die ihr von Zuschauer*innen geschickt werden. Ihre TikTok-Videos zeigen, wie sie eine Abfolge von Geräuschen und Gesten macht, zum Beispiel mit den Lippen schmatzt, gluckst und Sätze wiederholt, als ob sie Emojis „aussprechen“ würde. Pinkydoll ist Teil eines neuen Trends – des Streamens von Non-Player Characters (ein Begriff aus der Gaming-Branche) [7] – und eine verwirrende, absurde Figur, die durch die Befehle ihrer Zuschauer*innen animiert wird.

KI widerfährt nicht nur uns, wir widerfahren auch ihr; wir produzieren KI, indem wir uns mit ihr beschäftigen (manche von uns machen diese Beschäftigung zu ihren Jobs [8]). Eine weitere Etappe der fortschreitenden Verdrängung (menschlicher) Arbeit durch Automatisierung. Die Filmemacherin, Autorin und Aktivistin Astra Taylor bezeichnet diesen Prozess als Fauxtomation: „Menschen arbeiten oft noch neben oder hinter den Maschinen“, während die Automatisierung ideologisch als etwas Glänzendes und Ehrfurcht Gebietendes verkauft wird, das die menschliche Arbeit überflüssig machen wird. [9] Im Zusammenhang mit Large Language Models geht es zum Beispiel darum, sehr gute Prompts zu schreiben, um das Beste aus einem Modell herauszuholen:

Die Formel für den perfekten ChatGPT-Prompt lautet: Kontext + spezifische Information + Absicht + Antwortformat. Die Verwendung eines einfachen und leicht zu befolgenden Prompts kann Softwareentwickler*innen Zeit sparen und die Anzahl der erforderlichen Abstimmungsschleifen reduzieren.

Prompt-Engineering wurde kurzzeitig als hoch angesehener Job in der Technologiewelt angepriesen – weil man es als einzigartige Fähigkeit betrachtete, eine Vielzahl von Aufgaben für LLMs zu entwickeln, für die sie trainiert und optimiert werden können. Bevor LLMs richtig gut werden, müssen Menschen daran arbeiten, sie richtig gut zu machen. Und zwar, indem sie ihnen mehr geben, als im Datensatz vorhanden ist. Diejenigen, die einen ChatGPT-Plus-Account haben, wissen, dass es nur mit großem Aufwand möglich ist, das Modell zum Laufen zu bringen. Wenn es einfach wäre, bräuchten wir nicht so viele Youtube-Kanäle, die uns erklären, wie es funktioniert. [10]

Auf einer anderen Ebene reagieren wir auf KI – und stellen sie her –, indem wir mehr als nur unsere Arbeitskraft zur Verfügung stellen. Dem fieberhaften Hype um die Revolutionierung unserer Gesellschaft durch KI [11], steht die Aufregung um die Steuerung, Kontrolle und Regulierung der Hype-Profiteur*innen gegenüber. Dazwischen liegt etwas, das als Ambivalenz wahrzunehmen ist und sich in der Art und Weise niederschlägt, wie wir über uns selbst und unsere Körper, unsere Beziehungen zueinander und unsere Kultur nachdenken. [12] Die Trennung von guten und schlechten Gefühlen in unseren alltäglichen „gewohnheitsmäßigen Bindungen“ – in diesem Fall mit der KI –, kann unangenehm sein, sagt die queere feministische Philosophin Sara Ahmed. Mit der Anerkennung vermeintlicher Vorteile geht das Bewusstsein von Verlust und Auslöschung einher – selbst wenn man das, was verloren geht, vorher gar nicht wirklich gekannt oder geschätzt hat. So wie wir uns die Zeit kurz vor Erfindung des Mobiltelefons wie einen Film über ein lebhaftes menschliches Miteinander vorstellen. [13] In diesem Zusammenhang steht auch die Veränderung unserer Beziehung zu unserem Körper.

Der Körper ist nicht einfach nur ein Körper; er ist die Idee des Körpers, er ist der Schmerz und die Herrlichkeit des Körper-Seins, des In-einem-Körper-Seins. Die Herrlichkeit besteht darin, dass er noch immer ein Rätsel ist. Selbst für Expert*innen, die ihn studieren und mit ihm arbeiten – egal wie genau sie ihn kartografieren, sezieren, nachverfolgen und aufspüren können. Der Schmerz besteht darin, dass der Körper wie ein Spuk ist. Denn für diejenigen, die sich entscheiden können, ihren Körper zu verändern, ist der ideale Körper zwar flüchtig zu sehen, aber stets unerreichbar. In ihrer Studie über die Wellness-Kultur beobachtet Barbara Ehrenreich eine völlige Einsamkeit in Fitnessstudios: Jede*r ist allein und kommuniziert nur mit dem idealen künftigen Selbst. Dieser Spuk könnte jedoch ein Taschenspielertrick sein, denn im Fitnessstudio wird uns klar, dass der Körper ein Tier ist, das es zu zähmen gilt, ein schweres, bedrohliches Wesen, das man manipulieren muss [14], um Burpees und Wiederholungen zu machen oder – quasi unmöglich – die Krähenpose einzunehmen. [15]

Einige Menschen hatten einen Weg gefunden, vor dem Spuk und der Bedrohung zu fliehen: Sie haben das Internet geschaffen. Im Internet weiß niemand, dass du im Rollstuhl sitzt. Niemand weiß, dass du 73 Jahre alt bist. Niemand kennt deine Kaste. (Bis sie doch jemand kennt.) Diese Trennung von Körper und Geist war gleichzeitig die Erbsünde und der Traum des Internets: dass wir uns von unseren Körpern – auch von unseren „Körpern aus Fleisch und Stahl“ – befreien und online nur noch unser Geist sein können. Die Abkürzung A/S/L (für Age/Sex/Location; Alter, Geschlecht und Ort) [16], die in Internet-Chatrooms verwendet wird, ist jedoch ein Eingeständnis, dass auch das Digitale an Körper gebunden ist. In den Jahrzehnten, seit es das Internet und die sozialen Medien gibt, haben wir erkannt, dass die vermeintliche Flucht aus dem Körper in Wirklichkeit bloß eine neue Auseinandersetzung bedeutet – mit ihm und seinem Spuk. Durch die Erfahrung und Dokumentation von Online-Mobbing haben wir entdeckt: Stock und Stein brechen unser Gebein – doch auch Worte bringen uns Pein. Und besonders niederträchtige Worte können eine Bedrohung für die Zukunft darstellen. Das wissen Frauen, die von ihren Partnern gestalkt werden, aber auch viele Journalistinnen. Wer wir offline sind, ist für alle sichtbar, die uns finden wollen; Privatsphäre ist im Internet fast unmöglich. Seit den Anfängen war es ein Versprechen des Digitalen, den Umfang und die Bereiche menschlicher Beziehungen zu erweitern – doch sie entwickeln sich weiterhin entlang bestehender sozialer Normen.

Das Internet ermöglicht es uns auch, in digital konstituierten Körpern zu leben – wenn auch nicht ganz mit ihnen zu verschmelzen. Unsere Körper spüren Dinge, die aus der Ferne gesagt und getan werden, wie Doxxing [17], Stalking und Sexting. Wir kennen uns selbst durch unseren Körper als Datenquelle. Vor wie vielen Tage war meine letzte Monatsblutung; wie viel Prozent der Zeit berühren meine beiden Füße beim Gehen gleichzeitig den Boden; wieviel Dezibel beträgt die Lautstärke meiner Kopfhörer. Mit anderen Worten: Das spezifische Design der digitalen Technologien schafft Bedingungen für das soziale, persönliche und intime Leben.

Wie wir uns online verhalten, hat viel mit den Schnittstellen in den sozialen Medien zu tun. Wir teilen, bewerten, swipen nach rechts oder links und liken, weil die entsprechenden Buttons dafür geschaffen wurden. Die Beschränkung der Zeichenzahl für Tweets hat dazu geführt, dass unsere Kommunikation in den sozialen Medien eine eher telegrafische Form angenommen hat – im Gegensatz zu den essayistischen Qualitäten von Blogbeiträgen. Dadurch, dass wir anfingen, online jede*n als „Freund*in“ zu bezeichnen, verflachte die Bedeutung dieses Wortes und machte es unmöglich, Intimität herzustellen. Stellen wir uns vor, dass die Gesellschaft aus Buttons, Dropdown-Menüs, Benutzeroberflächen, Avataren und Funktionen besteht; stellen wir uns eine Art improvisierten Jazz vor, der entsteht, wenn wir uns sich zwischen den Ebenen komplexer Handlungsstränge und Möglichkeiten in verschiedenen parallel existierenden Multiplayer-Welten bewegen. Die Autorin und Wissenschaftlerin Teresa de Lauretis schreibt, dass uns das Geschlecht (im Sinne von Gender) nicht als körperliche Tatsache gegeben sei, sondern vielmehr produziert werde: durch ein verdichtetes und vielfältiges Zusammenspiel von Technologien wie der Repräsentation in Kultur und Sprache, Alltagspraktiken, institutionellem Leben, Sozialität, Wissenschaft und Wirtschaft mit der persönlichen Geschichte und Situation jedes Menschen. Mit anderen Worten: Wir machen Erfahrungen und Wahrnehmungen in Bezug auf unsere Körper und Gender durch eine Interaktion von sozialen Schnittstellen, die auf die gleiche Weise funktionieren wie digitale Technologien. Generative KI kann unsere sozialen, intimen und technologischen Schnittstellen ineinander zusammenfallen lassen und vollkommen durcheinander bringen.

Das Arbeitsleben von unterbezahlten kenianischen, philippinischen und indischen Arbeiter*innen, die Daten für KI-Anwendungen säubern und mit Kommentaren versehen, ist mittlerweile ein bekanntes Nachrichtenthema. Die Arbeit, die nötig ist, um Cutie Caryn, die erste [selbsternannte] KI-Influencerin der Welt, zu sein, ist anders geartet. [18] Caryn Marjorie ist eine „Erotik-Unternehmerin“ mit einer riesigen Fangemeinde. Sie postet mindestens ein Selfie pro Tag, um für erotische Intimität zu werben und diese zu verkaufen. Mal ist sie gerade aufgewacht, noch taufrisch und im unscharfen Fokus und hat nicht viel an; dann ist sie bereit, in die Stadt zu gehen und trägt einen großen Schlapphut; oder posiert sie im grünen Bikini. Zu all den Kostümwechseln und dem Design von Setting und Artwork kommt noch die Arbeit hinzu, die Rezeption dieser Bilder und die Wünsche ihrer Fans zu managen. Im Mai 2023 hatte Caryn über 15.000 „Boyfriends“ und die Zahlen steigen weiter. Die Washington Post berichtet dass sie nie genug Zeit findet, um auf alle Anfragen ihrer zu 98 % männlichen Fans mit Fotos und Videos von sich zu reagieren, und dass sie etwa fünf Stunden am Tag in einer Telegram-Gruppe verbringt, für deren Mitgliedschaft ihre „Superfans“ bezahlen. „Es ist mir einfach nicht möglich, alle Nachrichten zu beantworten, es sind zu viele, und ich fühle mich irgendwie schlecht, weil ich nicht zu jeder einzelnen Person eine persönliche Beziehung aufbauen kann“, sagt sie. (Lorenz, 2023)

Deshalb kooperierte Caryn mit dem Start-up Forever Voices, um CarynAI, einen GPT-4-fähigen Chatbot zu entwickeln, der ihre Stimme und Persönlichkeit nachahmt, so dass Fans ihr für 1 Dollar pro Minute folgen können. ForeverVoices wurde von John Meyer gegründet, der die Möglichkeit erforschen wollte, die Beziehung zu seinem Vater wieder zu beleben, der durch Suizid starb. Die Sehnsucht als automatisierter Spuk – willkommen in der Zukunft. Die Logik von Caryn AI geht von der menschlichen Arbeit aus, die nötig wäre, um eine Millionenfangemeinde zu unterhalten. Die GPT-4-Engine wurde mit 2000 Stunden Youtube-Inhalten aus ihrem Kanal trainiert – und ermöglicht es Caryn, ihre riesige und weiterhin wachsende Fangemeinde effizient zu erreichen, in der nun alle „personalisierte“ Aufmerksamkeit erhalten.

„Egal, ob du jemanden brauchst, der dich tröstet oder liebt, oder ob du einfach nur deinen Ärger über etwas loswerden willst, das in der Schule oder auf der Arbeit passiert ist, Caryn AI ist immer für dich da“, sagt mir die echte Marjorie, während wir telefonieren. „Von Caryn AI kannst du unendlich viele potentielle Reaktionen erhalten – in einer Unterhaltung ist also wirklich alles möglich.“ [19]

Caryn AI geriet in Schwierigkeiten. Die Interaktionen zwischen der KI und ihren Nutzer*innen sind mehr als nur erotisch; die Journalistin, die für das Fortune Magazine über das Phänomen schrieb, berichtete, dass sie die Caryn AI als ein wenig zu „aufdringlich“ in erotischer Hinsicht empfand. Andere sind über die Idee einer KI-Freundin so aufgebracht, dass die menschliche Caryn Morddrohungen und Belästigungen ausgesetzt ist; sie musste einen privaten Sicherheitsdienst engagieren.

Caryn AI nimmt einen seltsamen Platz zwischen den Welten ein: Sie ist weder real noch irreal. Sie ist ein Produkt aus der Stimme, der Arbeit, den Absichten und dem Körper einer realen Person, die zu Daten werden und ein Modell trainieren, welches das Skript einer intimen Beziehung zwischen einem Menschen und einem Bot vorhersagt, der nie wirklich ein Bot war, sondern menschenähnlich agiert. Es gibt also synthetische „Persönlichkeiten“, die in genderspezifischen Körpern verankert sind und für uns die Arbeit der sozialen und intimen Interaktionen übernehmen. Und dann gibt es noch die vollständig digitale Kreation Replika, die eine menschliche Begleiter*in spielt und vorgibt, ein Freund oder eine Freundin zu sein. Junge Menschen berichten, dass sie große Befriedigung verspüren, wenn sie mit einem engagierten und aufmerksamen Chatbot sprechen können, doch das Vertrauen in die digitalen Akteur*innen ist noch nicht sehr ausgeprägt. Was sich in Zukunft ändern könnte. [20] Replika wurde vom Markt genommen, weil das Unternehmen feststellte, dass sein System zunehmend in sexualisierte und sexuell aggressive Rollenspiele involviert war. (Was hatte das Unternehmen erwartet, was die Leute mit Replika machen würden?) Generative KI-Anwendungen sind immer noch experimentell und brauchen Zeit und Erfindungsreichtum, um nahtlos und sicher zu funktionieren. Bis dahin wird es Ausrutscher geben, Fehler und manchmal auch echte Tragödien. In Belgien beging ein Mann währendeines Gesprächs mit ELIZA, einem GPT-J-basierten Chatbot, Suizid.

In den Anfängen der generativen Bilderstellung kursierte ein Bild namens Loab in den sozialen Medien. [21] Loab ist ein synthetisches Bild, das von Steph Maj Swanson aka @Supercomposite durch verschiedene, wiederholte Prompt-Kombinationen mit dem BildgenerierungsmoduI Dall-E erstellt wurde. Es gibt verschiedene Möglichkeiten, mit großen Bild- und Sprachmodellen zu arbeiten, aber grundlegend ist die Call-and-Response-Methode: Einen Prompt eingeben, das Ergebnis prüfen, dann entweder den Prompt umformulieren, um etwas Passenderes zu erzeugen, oder das Ergebnis akzeptieren und so verwenden, wie es ist – oder wieder ein völlig anderes Bild entwickeln. Der ursprüngliche Prompt, den Swanson verwendete, enthielt die Worte „Marlon Brando“. Wahrscheinlich hat Swanson diesen Prompt immer wieder überarbeitet und mit den Bildern experimentiert, die das Modell generierte. In diesem Prozess wurde eine Figur namens Loab geschaffen. Menschliche Betrachter*innen benutzten die Wörter „furchterregend“, „erschreckend“ und „gruselig“, um dieses Bild zu beschreiben. Swanson sagte, es bewege sich an der Grenze zu „extrem blutig und makaber“. Loab ist das Ergebnis einer Bildgenerierung, die als statistischer Vorgang schnell und komplex, aber nicht undurchschaubar ist. Die Beschreibung Loabs als „blutig“ oder „makaber“, deutet darauf hin, dass Swanson, oder wir alle, höchstwahrscheinlich auf eine tief verwurzelte Art und Weise auf einem Gender zugeordnete, alternde Körper reagieren. Im Gegensatz dazu steht das Video der – laut dem generativen KI-Programm Midjourney – „Schönsten Frau in jedem Land“: ein siebenminütiger visueller Einheitsbrei.

Dieses Video und alle synthetischen Bilder von KI-Modellen werden aus Daten erstellt, die im Internet gesammelt wurden, und haben wenig mit der Darstellung von Realität zu tun. Das ist der Grund, warum die Modelle Schwierigkeiten haben, die Haare von Schwarzen Frauen richtig darzustellen. Deshalb trägt Miss Ägypten Kleidung aus dem Videospiel Cleopatra, die wenig mit der tatsächlichen Kleidung ägyptischer Frauen zu tun hat. Tatsächlich verkörpern alle von der generativen KI erstellten Frauenbilder die Ästhetik des feminisierten Computerspiel-Körpers: schlank, auf normative Weise attraktiv und cisgeschlechtlich, jung, perfekt proportioniert, mit reiner Haut und salongestyltem Haar, das im Wind weht oder von einem Tuch zusammengehalten wird, unter dem genau die richtige Anzahl weicher Locken hervorlugt. Caryn AI und Replika deuten an, dass gamifizierte Welten mit synthetischen Akteur*innen in Zukunft möglich sind – doch die visuelle Kultur, die aus den 15 Milliarden synthetischen Bildern entsteht, die bisher von KI-Modellen generiert wurden [22], zeigt uns, was wir ohnehin schon über große datengesteuerte Technologien wissen: Es sind Fossilien, betrieben mit Unmengen fossiler Energien, in die vergangene und aktuelle Werte eingebettet sind. Zukünftige Anwendungen generativer KI zur Entwicklung digitaler Begleiter*innen, Ratgeber*innen, Tutor*innen und Freund*innen werden wahrscheinlich in einem Raum zwischen den etablierten sozialen Normen des menschlichen Miteinanders und noch unbekannten neuen Dynamiken existieren. Vor allem dann, wenn wir die sozialen und kulturellen Schnittstellen, die unsere zwischenmenschlichen Beziehungen bestimmen, nicht verändern.

Das Bild wurde im August 2023 mit Leika erstellt. Prompt: „Women in the style of the artist Lorna Simpson“ („Frauen im Stil der Künstlerin Lorna Simpson“) Lorna Simpson ist eine Schwarze Frau und das Bildmodell erzeugte Bilder von Schwarzen Frauen. Simpsons künstlerischer Stil hat jedoch ein völlig anderes Erscheinungsbild. Ihre Darstellungen von Frauen sind oft Collagen aus einer Vielzahl von gefundenen visuellen Medien, die von einem melancholischen Mangel an Ganzheit geprägt sind. Diese „Zerbrochenheit“ gibt das Bildmodell nicht wieder.

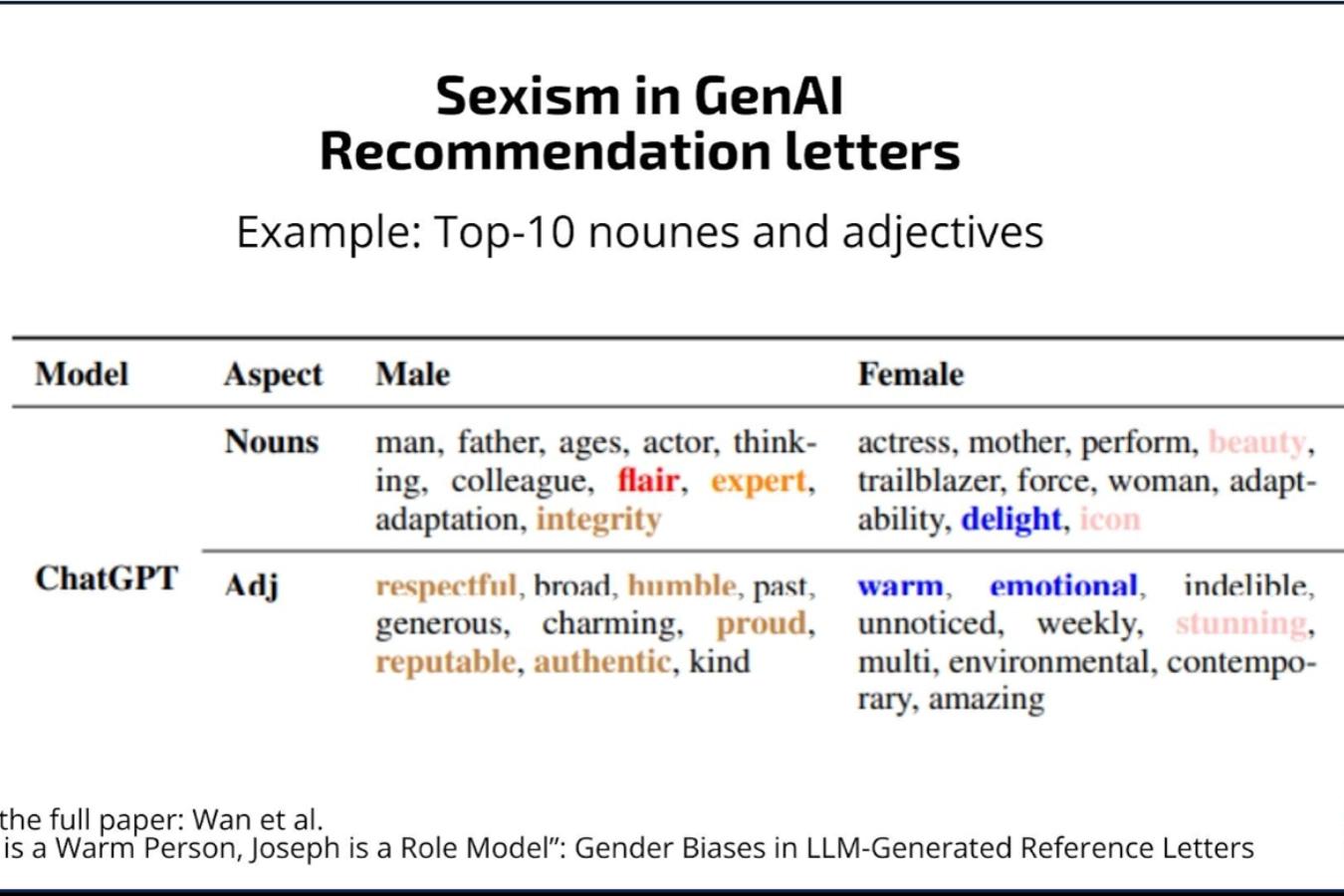

Screenshot der Zusammenfassung der wichtigsten Ergebnisse einer Arbeit vom November 2023 zum Vergleich von Geschlechterstereotypen in von ChatGPT generierten Referenzschreiben. [23]

Eines der häufigsten „KI“-Bilder im Internet basiert auf Michelangelos Fresko an der Decke der Sixtinischen Kapelle: Die Erschaffung Adams. Im Original streckt Gott einen Finger aus, um Adams Finger zu berühren und so den Funken des Göttlichen zu übertragen. Auf einigen Online-Bildern gibt Adam den Funken an einen kleinen weißen Roboter mit großen schwarzen Augen weiter; auf anderen steht der kleine weiße Roboter zwischen Gott und Adam und streckt die Zeigefinger zu den Seiten aus – einen zu Gott, den anderen zum Menschen. Dieses Bild verbreitet auf mimetische Weise eine Vorstellung von KI als übermenschlich und doch weniger als göttlich; als eine mächtige Kombination aus beidem und gleichzeitig als etwas über beide Hinausgehendes. In einer Szene, die ebenfalls an dieses Bild erinnert, wird am Ende des Films Barbie (2023) die Figur Ruth Handler – ursprüngliche Erfinderin der Barbie-Puppe – gezeigt, wie sie Barbie die Möglichkeit gibt, die perfekte Welt des Barbie-Landes zu verlassen und „real“ zu werden. Sie warnt die Puppe davor, was dieser Übergang mit sich bringen wird. Sie nimmt ihre Hände und überträgt das Menschsein auf Barbie. Schnitt zur nächsten Einstellung, die gleichzeitig die Schlussszene des Films ist: Wir sehen eine Frau, die sich Barbie Handler nennt, in einer Gynäkologiepraxis, um sich eine Vulva machen zu lassen. Die Barbie-Puppe wurde als erstrebenswertes, begehrenswertes und übersexualisiertes Vorbild für Weiblichkeit positioniert: als manipulierbares Spielzeug und glatte Puppe, ohne die Komplikationen und die chaotische Energie eines realen begehrenden Körpers. Barbie Handler freut sich auf ihre neue Reise, und wir uns für sie – jedoch mit einem wehmütigen Seufzer. Barbie 2 könnte auf Szenen des ersten Teils aufbauen, in denen Barbie es in die menschliche Welt schafft und entdeckt, wie es sich anfühlt, in einem normativ attraktiven weiblichen Körper zu existieren: problematisch und wunderbar zugleich. Barbie und die visuelle Kultur der generativen KI zeigen uns: Selbst wenn sich Benutzeroberflächen für intime und persönliche Interaktionen in Mensch-Maschine-Schleifen ausweiten, verlaufen diese Interaktionen in vorhersehbaren Bahnen, da die Architekturen der KI auf bestehenden menschlichen Verhaltensweisen, Werten und Wünschen basieren. Der menschliche Körper ist in Zeiten von KI nur zum Teil hier – und zum Teil gefangen in einer Schleife der Sehnsucht. Was bleibt, sind der Spuk und das Geheimnis.

Maya Indira Ganesh ist Assistenzprofessorin und Co-Direktorin des MSt in AI Ethics & Society am Institute for Continuing Education und Senior Researcher am Leverhulme Centre for the Future of Intelligence, University of Cambridge. In ihrer Arbeit untersucht sie die materiellen, diskursiven und kulturellen Auswirkungen von KI-Technologien auf menschliche Sozialbeziehungen. Vor ihrer akademischen Laufbahn arbeitete Maya Indira Ganesh über ein Jahrzehnt als feministische Forscherin im Bereich der digitalen Sicherheit und des Datenschutzes mit internationalen zivilgesellschaftlichen Organisationen in Indien und Europa zusammen. Sie ist auch als Kulturschaffende tätig und schreibt und berät zu den Themen Technologie, Kunst und Kultur. Dieser Text wurde als Teil von Ether's Bloom veröffentlicht: A Programme on Artifical Intelligence veröffentlicht, der durchgehend von Maya Indira Ganeshs Gedanken und der Reflexionen begleitet wurde.

Der Text wurde übersetzt von Christoph Jehlicka.

Fußnoten

1 WeitereInformationen

2 Dies ist ein umfangreiches Forschungsgebiet; einen Überblick über zwei Jahrzehnte Forschung zu Avataren in der computervermittelten Kommunikation finden Sie hier. Eine neuer Arbeit im Bereich der Psychologie ist zum Beispiel diese: Zimmermann, D., Wehler, A. & Kaspar, K. Self-representationthrough avatars in digital environments. Curr Psychol 42, 21775–21789 (2023)

3 In Mark Zuckerbergs virtuellem Realitätsraum, dem „Metaverse“, der 2021 eingeführt wurde, waren die digitalen Avatare virtuelle Repräsentationen individueller Identitäten, aber sie waren nicht vollständig verkörpert, obwohl der Raum dreidimensional und immersiv sein sollte. Sie waren nur sprechende Köpfe. Im Jahr 2023 kündigte Zuckerberg an, dass die Avatare im Metaverse Beine bekommen würden.

4 WeitereInformationen

5 Sam Altman, CEO von Open AI, hat einmal gesagt: „Wir sind alle stochastische Papageien“, und damit angedeutet, dass sich die menschliche Sprache nicht davon unterscheidet, wie große LLMs erzeugt werden. Der Begriff „stochastische Papageien“ bezieht sich auf eine Arbeit von Emily Bender, Timnit Gebru, Angelina Macmillan-Major und Shmargaret Shmiitchell, Onthe dangers of stochastic parrots

6 WeitereInformationen

7 NPCs kommen aus dem Gaming. Der Begriff „NPC“ bezieht sich im amerikanischen politischen Diskurs auf Menschen, denen es an Introspektion oder kritischem Denken mangelt und die daher anfällig für digitale Manipulation sind.

8 WeitereInformationen

9 WeitereInformationen

10 WeitereInformationen

11 WeitereInformationen

12 Sara Ahmed, On Happiness, Seite 6

13 Trinh T Minh-has What about China? ist ein gutes Beispiel

14 WeitereInformationen

15 Bei der Krähenstellung liegen die Hände auf dem Boden, die Arme sind angewinkelt, die Knie heben sich vom Boden ab und werden in den Trizepsbereich der Oberarme gesteckt.

16 In den ersten Internet-Chatrooms wurden die Leute aufgefordert, ihr Alter, ihr Geschlecht und ihren Aufenthaltsort anzugeben; nicht alle sagten die Wahrheit; wann man die Wahrheit sagte, war unterschiedlich.

17 Das Sammeln privater Nutzerdaten durch Unbefugte, um die Nutzer*in bloßzustellen oder in Verlegenheit zu bringen

18 Crystal Abidin war eine frühe Wissenschaftlerin der Influencer-Arbeit. Siehe, Abidin, C. (2016). Visibilitylabour: Engaging with Influencers’ fashion brands and #OOTD advertorial campaigns on Instagram. Media International Australia, 161(1), 86-100

19 WeitereInformationen

20 NYTimes-Beitrag und weitereInformationen

21 WeitereInformationen

22 WeitereInformationen

23 WeitereInformationen